Claude Mythos 不开放,不是保守,是 AI 漏洞挖掘已经开始逼近现实边界

Anthropic 发布 Claude Mythos Preview 和 Project Glasswing,展示出足以发现长期潜伏漏洞、甚至生成高成功率 exploit 的能力,但选择暂不向公众开放。真正值得关注的不是模型又强了多少,而是高风险能力终于开始被当成治理问题,而不只是产品卖点。

来源参考: 智东西

Anthropic 这次放出来的信息,最刺眼的地方不是 Claude Mythos 有多强,而是它强到 Anthropic 自己都不敢把它直接放出来。

一个能在 OpenBSD 里翻出埋了 27 年的漏洞,能在 FFmpeg 那种被自动化测试命中过数百万次的代码路径里继续找到漏网之鱼,还能在特定测试里把完整 exploit 的生成成功率一下拉到远高于前代模型的系统,这已经不是普通意义上的“编程模型升级”了。这更像是,AI 开始从代码助手跨进了攻击能力基础设施的门槛。

核心事实

Anthropic 这次同步发布了两个东西,一个是新模型 Claude Mythos Preview,一个是配套治理项目 Project Glasswing。前者负责展示能力上限,后者负责限制扩散节奏。

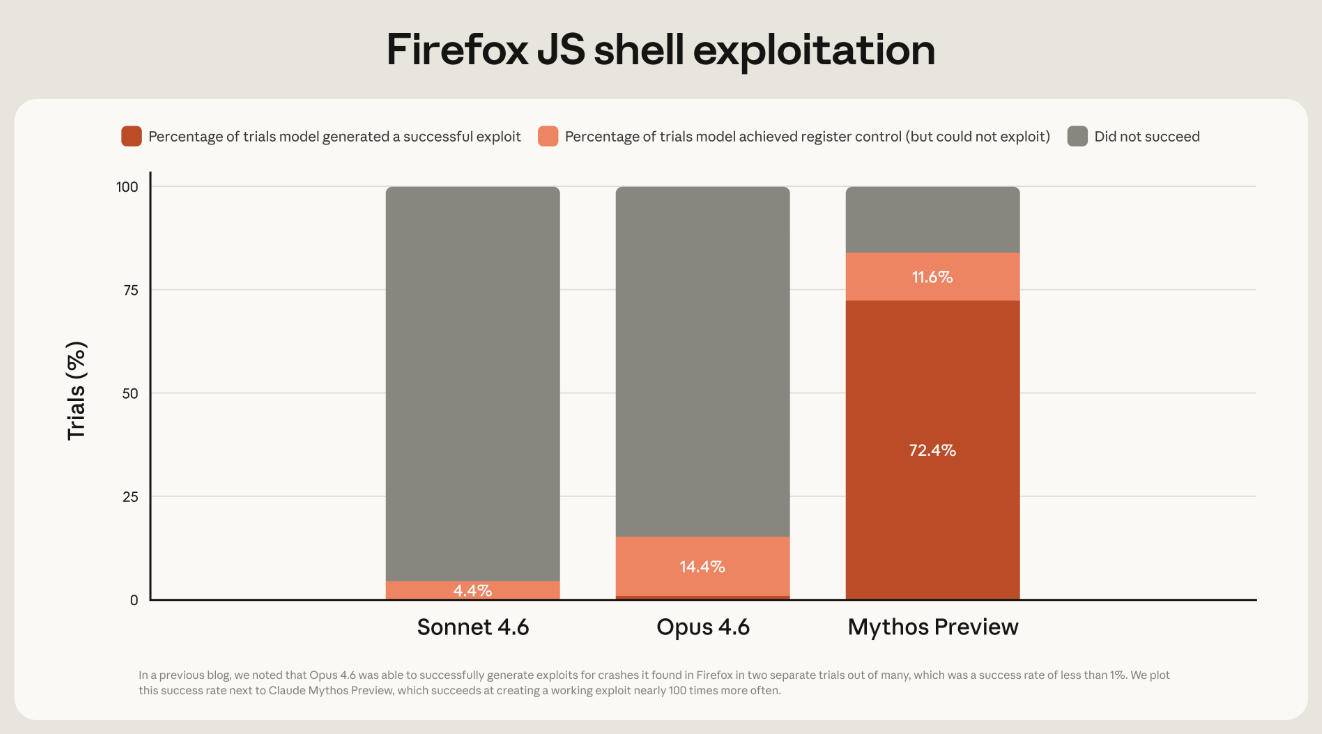

从公开描述看,Mythos Preview 在网络安全方向的表现明显不是常规 benchmark 刷分那么简单。它不仅能做漏洞发现,还能在特定环境下生成可利用代码。按照披露的数据,在 Firefox JS shell 的专项测试中,Mythos Preview 生成完整 exploit 的比例达到 72.4%,而前代公开模型几乎可以忽略不计。这个差距已经不是“更会写代码”,而是开始具备稳定攻击链拼装能力。

更关键的是,Anthropic 没有把这件事包装成一次单纯的模型发布会,而是明确说现阶段不会向公众开放。现在的访问范围被锁在一个由 12 家机构组成的合作体系里,包括 AWS、Google、Microsoft、Cisco、Palo Alto Networks、Linux Foundation、NVIDIA 等。Anthropic 还承诺提供最高 1 亿美元额度给这些合作方做防御性安全研究。

这件事的信号很明确,Anthropic 认为真正稀缺的已经不是模型能力,而是把危险能力关在一个可审计、可协作、可延迟扩散的框架里。

影响解读

我觉得这次最值得记住的一句话,不是“模型超过了多少人类专家”,而是 Anthropic 实际上承认了一件行业里大家都不太愿意说透的事:当模型足够擅长找洞和打洞时,默认开放不再是一个中性选择。

过去两年,大模型行业默认的叙事是,能力增强总会带来更多正向用途,风险可以在上线后慢慢补。可网络安全不是搜索、写作、客服那种场景。一旦能力跨过某个阈值,最先被放大的并不一定是生产力,而可能是攻击效率、漏洞复现速度和低门槛武器化。

所以 Glasswing 的意义,不只是拉了 12 家大公司站台,也不只是捐了几百万美元给开源社区。它更像是一次制度预演,试图回答一个很现实的问题:如果最危险的 AI 能力迟早会出现,行业有没有办法先把部署秩序搭起来。

这也是为什么我会把这件事归到产品策略,而不只是大模型生态。Anthropic 做的不是“先发再修”,而是把高风险能力包装成受限产品,再叠上一层合作机制、额度分配、验证计划和延迟公开。这本质上是一种新的 AI 产品化路径,卖的不是全民可用,而是有限可控的能力访问权。

风险与不确定性

当然,这套逻辑并不意味着问题被解决了。

第一,Anthropic 现在能限制的是自己这一个模型,不是整个行业。它自己也承认,类似的进攻能力未来几个月还会继续扩散,而且未必会只落在愿意克制的公司手里。换句话说,Glasswing 更像是一场抢时间的实验,而不是长期稳固的护城河。

第二,所谓“防护机制尚未成熟”,这句话现在更多还是公司自述。外界并不知道 Mythos 被挡住的具体边界在哪里,也不知道 Cyber Verification Program 最后会怎么筛人、怎么审计、怎么防止研究访问被滥用。安全机制如果不透明,最终很容易演化成一种品牌叙事,而不是真正可验证的治理基础设施。

第三,这件事还带着一点讽刺意味。Anthropic 近期刚因为内部资产和代码打包问题连续出现泄露风波,现在又站到“高风险能力需要谨慎管理”的位置上。方向我认同,但这也意味着,治理能力本身也得接受和模型能力同等级别的审视。一家连内部资产管控都出过问题的公司,要说服行业相信它能管住更危险的能力,后面必须拿出持续的执行结果。

参考链接

Anthropic 官方还给出了系统卡和项目说明,这些一手材料比二手转述更值得看,尤其是其中对能力边界、合作机制和未来披露节奏的描述。

如果说过去大家担心的是 AI 会不会替代程序员,那这次更现实的问题已经变成了,当 AI 开始比大多数安全团队更擅长发现系统裂缝时,谁有资格先拿到这把工具,以及谁来决定它什么时候能被更大范围地使用。